EU AI Act i pravni uredi - što se mijenja od kolovoza 2026.

6. svibnja 2026.

EU AI Act (Uredba (EU) 2024/1689) ušao je na snagu 1. kolovoza 2024. Rok za primjenu većine obveza za sustave visokog rizika je 2. kolovoza 2026. - tri mjeseca od danas.

Za odvjetnika koji već koristi AI alate u svakodnevnom radu, ili koji planira to učiniti, ovo nije apstraktno regulatorno pitanje. To je praktičan rok za provjeru: koji alati rade u vašem uredu, pod kojim uvjetima, i što pružatelj mora osigurati.

Ovaj tekst nije sveobuhvatni pravni komentar Uredbe - to bi bio poseban angažman. Cilj je jasniji: objasniti koje kategorije su relevantne za odvjetnički ured, gdje je granica između visokog i ograničenog rizika, i što bi svaki odvjetnik trebao provjeriti od dobavljača AI alata do kolovoza.

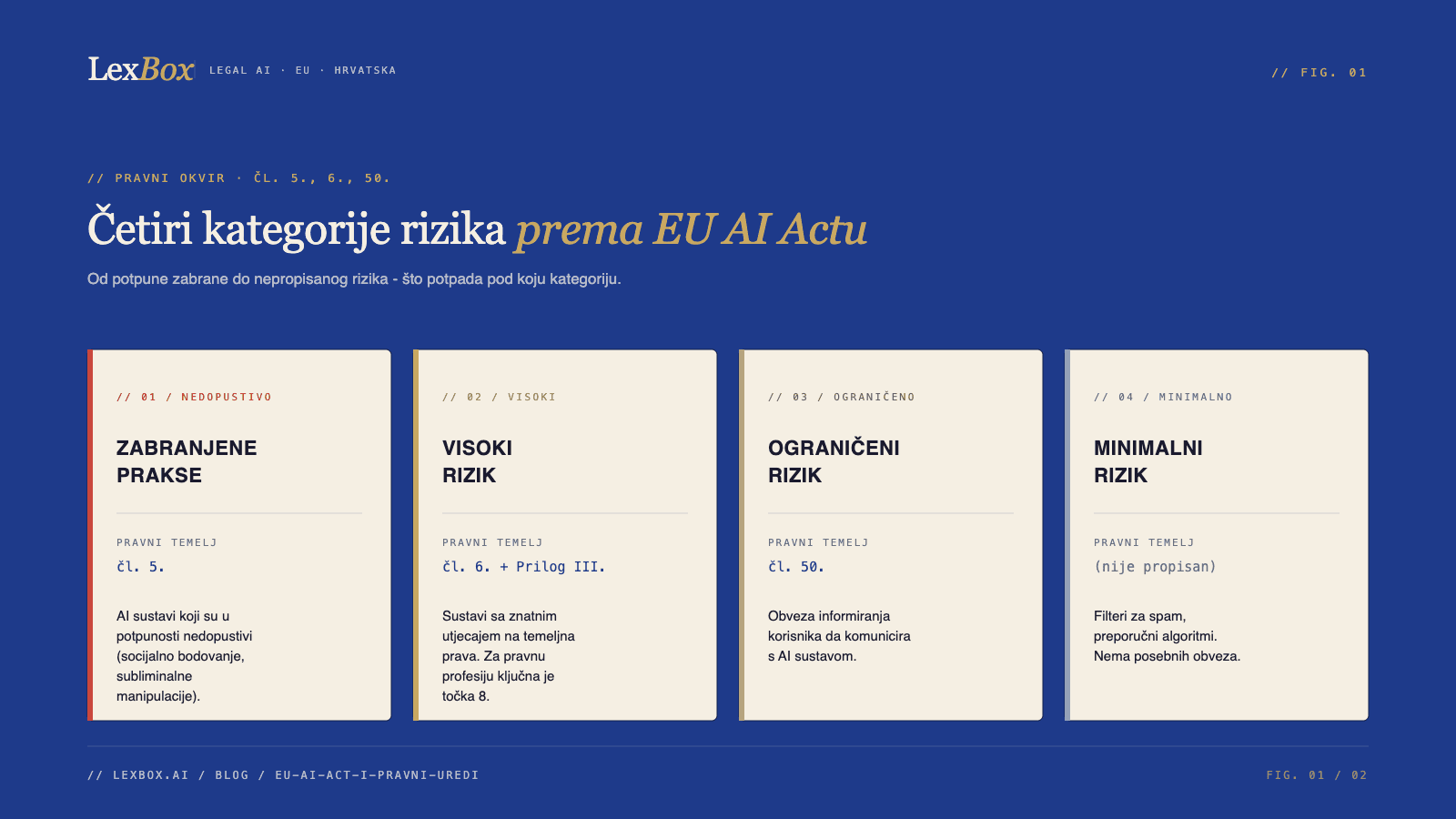

Četiri kategorije rizika i gdje pravna struka pada

EU AI Act razvrstava AI sustave u četiri kategorije prema razini rizika koji nose za temeljna prava i sigurnost korisnika.

Zabranjene prakse (čl. 5.) - AI sustavi koji su u potpunosti nedopustivi: socijalno bodovanje građana od strane javnih tijela, subliminalne manipulativne tehnike, biometrijska kategorizacija na osnovi osjetljivih obilježja za određene svrhe, i slično. Za uobičajene pravne AI alate ova kategorija nije relevantna.

Visoki rizik (čl. 6. i Prilog III.) - AI sustavi koji mogu imati znatan utjecaj na temeljna prava ili sigurnost osoba. Ovdje je ključna distinkcija za pravnu struku, o čemu više u sljedećem odlomku.

Ograničeni rizik (čl. 50.) - AI sustavi koji komuniciraju s korisnicima moraju informirati korisnika da komunicira s AI sustavom. Ovo se primjenjuje na gotovo sve pravne AI alate koji imaju sučelje za razgovor ili generiraju tekstualni sadržaj.

Minimalni rizik - svi ostali sustavi, od filtera za spam do preporučnih algoritama u videozabavi. Nema posebnih obveza.

Prilog III., točka 8. - ključna granica za pravnu profesiju

Prilog III. Uredbe navodi konkretne kategorije sustava koji automatski potpadaju pod visoki rizik. Točka 8. odnosi se na AI u pravosuđu i demokratskim procesima - i za pravne urede je najvažnija.

Prema toj odredbi, visoki rizik predstavljaju AI sustavi namijenjeni korištenju od strane suda ili drugog pravosudnog tijela za istraživanje i tumačenje činjenica i prava te primjenu prava na konkretni skup činjenica - ili sustavi koji se na sličan način koriste u alternativnom rješavanju sporova.

Ključna je formulacija "od strane suda". Ako sud koristi AI sustav za pripremu ili donošenje odluka, to je visoki rizik. Ako odvjetnik koristi AI alat kao podršku vlastitom istraživačkom radu - za pretraživanje sudske prakse, analizu ugovora, provjeru rokova - taj alat ne ispunjava automatski uvjete ove kategorije, pod uvjetom da odvjetnik preuzima punu profesionalnu odgovornost za konačni rezultat.

Razlika nije sitničava niti formalna. Sustav koji podržava odvjetnikovu prosudbu razlikuje se od sustava koji zamjenjuje sudsku prosudbu. Ova distinkcija je temelj klasifikacije prema Uredbi.

To ne znači da ne postoje nikakve obveze. Ograničeni rizik (čl. 50.) i opće zahtjeve transparentnosti pružatelji moraju ispunjavati bez obzira na kategoriju.

Što se traži od pružatelja AI alata za pravne urede

Pružatelji AI sustava koji potpadaju pod ograničeni rizik moraju prema čl. 50. Uredbe osigurati da korisnici znaju da komuniciraju s AI sustavom, da sintetički generirani sadržaj ne zavodi korisnike, i da postoji jasna razlika između AI-generiranog i ljudski generiranog sadržaja.

Pružatelji sustava visokog rizika imaju znatno veće obveze: uspostavljanje sustava upravljanja rizicima (čl. 9.), nadzor kvalitete podataka za treniranje (čl. 10.), tehničku dokumentaciju koja se mora čuvati i biti dostupna nadzornim tijelima (čl. 11.), transparentnost prema deployers i korisnicima (čl. 13.) te tehničke mjere za osiguranje ljudskog nadzora (čl. 14.).

Za pružatelje koji tvrde da njihov alat nije visokog rizika, razumno je pitati za obrazloženje klasifikacije. Uredba ne predviđa mehanizam samoproglašenja bez osnove - pružatelj mora biti u mogućnosti argumentirati zašto određeni sustav ne potpada pod Prilog III.

Obveze odvjetnika kao korisnika sustava

Pod EU AI Actom, odvjetnik koji koristi AI alat u profesionalnom radu spada u kategoriju "deployer" - korisnik koji primjenjuje sustav u određenom poslovnom kontekstu. Za sustave koji nisu visokog rizika, obveze su ograničene, ali postoje praktični koraci koji su razumni i danas.

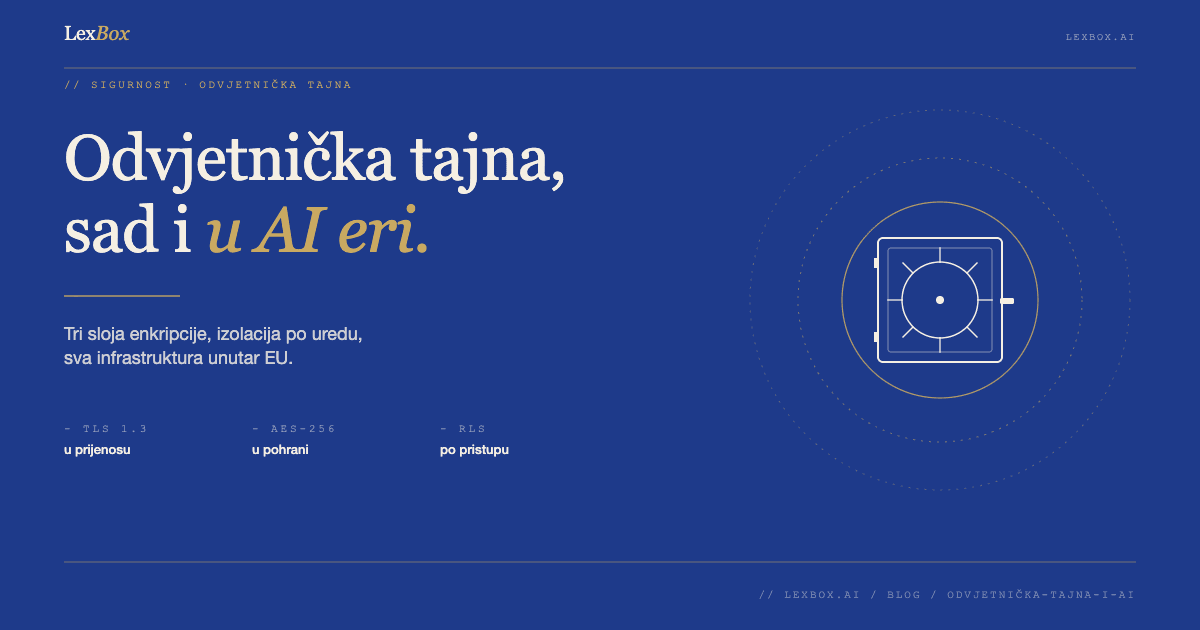

Provjera dobavljača i DPA lanca. Ima li pružatelj AI alata koji koristite jasno definirano gdje su vaši podaci: gdje se pohranjuju, tko ih procesira, pod kojom jurisdikcijom? Za odvjetnika koji radi s povjerljivim klijentskim podacima ovo je i neovisno o EU AI Actu obveza iz čl. 13. Zakona o odvjetništvu. Postoji li Ugovor o obradi podataka (DPA) prema čl. 28. Opće uredbe o zaštiti podataka (GDPR)? Ako nema, to je rizik koji postoji već danas.

Transparentnost prema klijentima. Trebate li informirati klijenta da ste koristili AI u pripremu podneska ili pravnog mišljenja? EU AI Act ne propisuje automatsku obvezu za sve slučajeve, ali opće odvjetničke etičke obveze prema klijentima mogu to zahtijevati, ovisno o situaciji. Ovo je pitanje za vašu odvjetničku komoru i internu politiku ureda.

Dokumentacija postupka. Kako koristite AI alate, za koje zadatke, s kojim sigurnosnim okvirom na snazi? Osnovna interna dokumentacija nije samo dobra praksa - u slučaju inspekcije nadzornog tijela, to je polazna točka za demonstraciju odgovornog korištenja.

Praćenje smjernica. EU AI Act je živ regulatorni okvir. Europski odbor za AI (AIEC) i nacionalna nadzorna tijela objavit će pojašnjenja za specifične sektore i slučajeve primjene. Vrijedi pratiti razvoj, posebno u prvoj godini primjene visokog rizika.

Gdje je LexBox u ovom okviru

Transparentnost nalaže da i o vlastitom alatu govorimo bez pretjerivanja. Nismo nadležno tijelo koje može dati konačnu pravnu klasifikaciju - to bi bila hiperbolika.

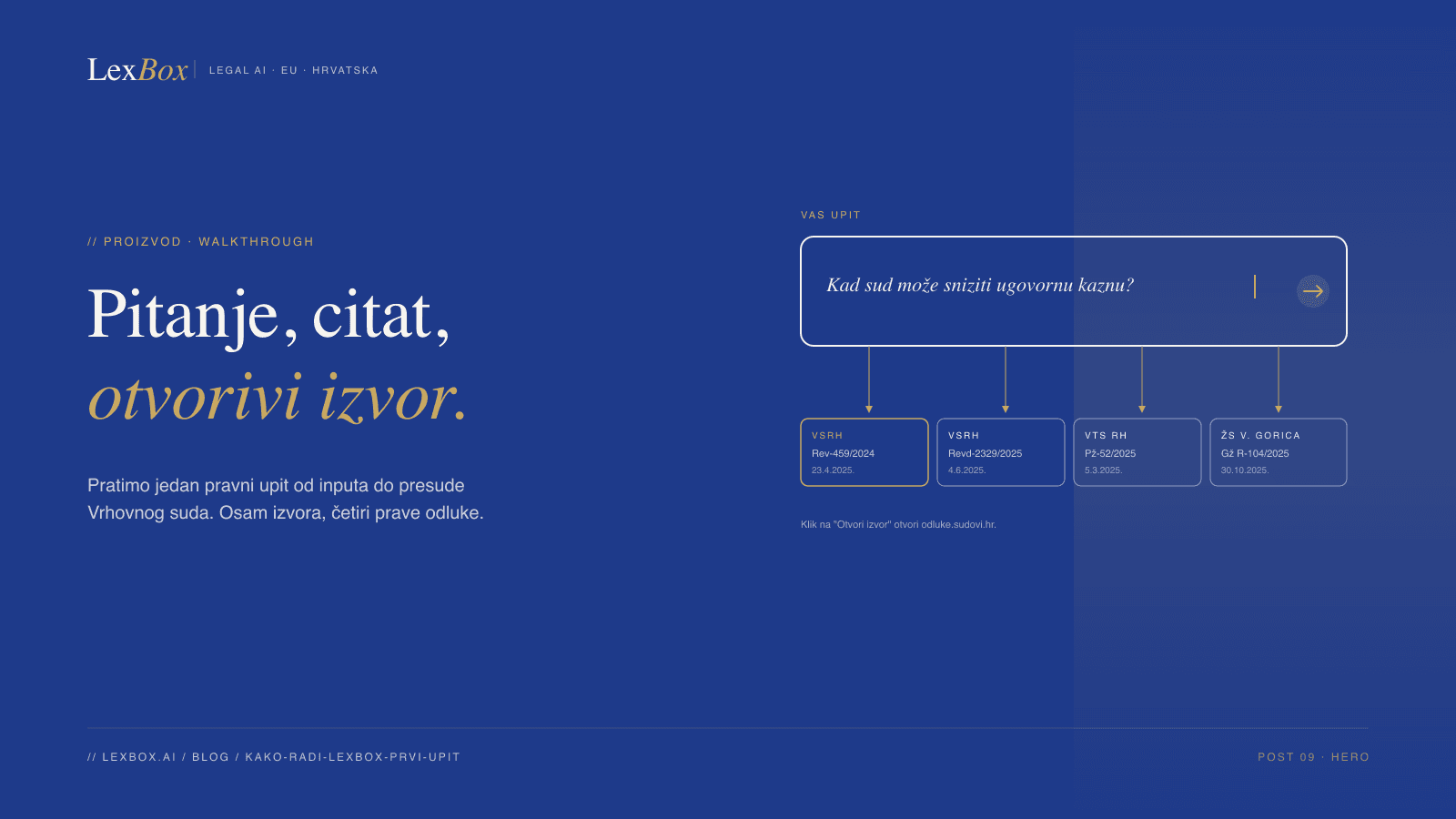

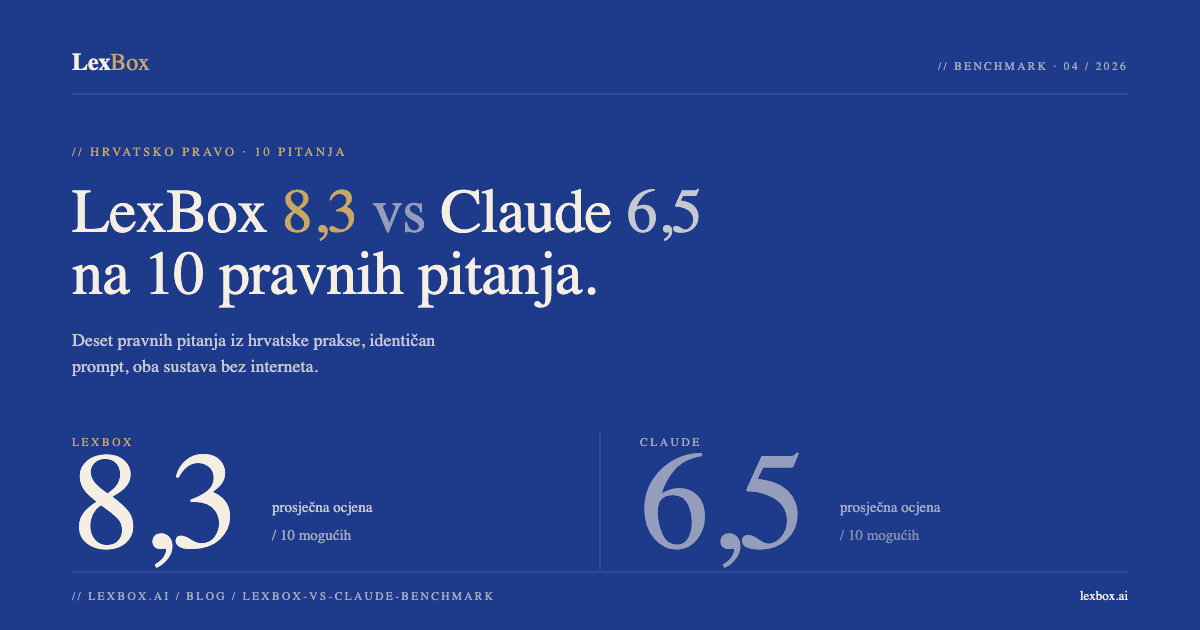

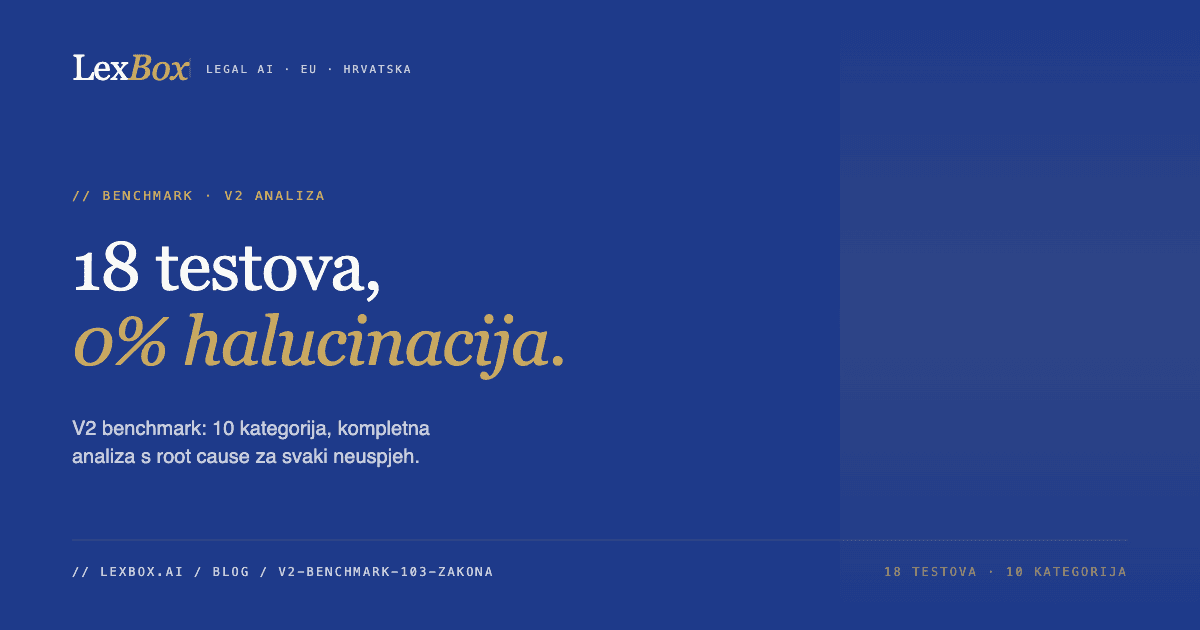

Ono što možemo reći, i što je javno dostupno: LexBox je namijenjen odvjetnicima kao podrška istraživačkom radu, ne sudovima za donošenje odluka. Svaki odgovor citira provjerljive izvore - zakone, presude, EU dokumente - koje odvjetnik može i treba provjeriti. Infrastruktura je smještena isključivo u EU (Hetzner Nürnberg + Scaleway Paris). DPA lanac aktivan je sa svim pod-izvršiteljima, uključujući Hetzner, Scaleway, Mistral i Supabase, kako je javno navedeno u tehničkom pregledu sigurnosnih mjera. LLM pružatelji ne pohranjuju API upite za treniranje modela prema vlastitim uvjetima korištenja.

Ako evaluirate AI alate za odvjetnički ured u kontekstu kolovoza 2026., ovo su pitanja koja vrijedi postaviti svakom pružatelju - i na čije odgovore imate pravo.

Praktični koraci do kolovoza 2026.

Za odvjetnički ured koji danas koristi ili razmatra AI alate, pregled od pet točaka:

- Popis AI alata u upotrebi - identificirajte sve AI sustave koje koristite u profesionalnom radu, od generičkih asistenta do specijaliziranih pravnih alata

- Provjera kategorije rizika - je li alat namijenjen podršci odvjetnikove prosudbe ili zamjeni procesne odluke? Zatražite od pružatelja obrazloženje klasifikacije

- DPA i lokacija podataka - postoji li potpisan DPA prema čl. 28. GDPR-a? Gdje se vaši podaci fizički nalaze?

- Interna dokumentacija - zabilježite kako i za što koristite AI u uredu; to je polazna točka za demonstraciju odgovornog korištenja

- Praćenje regulatornih smjernica - AIEC i hrvatska nadzorna tijela objavit će pojašnjenja; vrijedi imati nekoga u uredu tko prati razvoj

EU AI Act formalizira ono što odgovorni pružatelji ionako trebaju raditi: transparentnost o tome što sustav jest i što nije, jasna lokacija podataka, mehanizmi za ljudski nadzor nad AI rezultatima. Za odvjetnika, kriterij procjene AI alata nije promijenjen - samo je sada regulatorno utemeljen.

Zanima vas kako LexBox može pomoći vašem timu?

Isprobajte besplatno